위키 구독하기

Share wiki

Bookmark

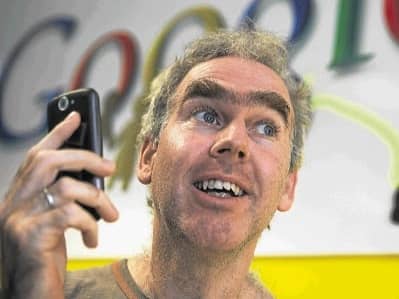

Johan Schalkwyk

0%

Johan Schalkwyk

**요한 샬크위크(Johan Schalkwyk)**는 인공지능, 특히 음성 기술 및 대규모 언어 모델 분야에서 활동하는 컴퓨터 과학자입니다. 그는 Google에서 음성 검색 및 멀티모달 AI와 같은 분야에 기여하며 중요한 역할을 수행했으며, 현재는 에너지 전환을 위한 AI에 집중하는 Sense에서 전략 고문으로 활동하고 있으며 최근에는 Meta Superintelligence Labs에 합류했습니다. [1] [2] [36]

교육

요한 샬크위크는 프리토리아 대학교에서 강화 학습을 중심으로 로봇 공학 석사(M.Eng.) 학위를 받았습니다. 그는 1993년에 GPA 4.0으로 프로그램을 마쳤습니다. [39]

경력

요한 샬크위크는 Google에서 상당 기간 동안 근무하며 AI 분야의 Google Fellow로 인정받았습니다. Google에서의 그의 연구는 인공지능 및 머신러닝 내의 여러 핵심 영역에 걸쳐 있었습니다. 음성 영역 기술 책임자로서 그는 음성 인식 및 합성 기술에 대한 전략적 연구 투자를 지휘했습니다. 이러한 리더십은 2008년에 출시된 세계 최초의 음성 지원 검색 경험인 Google 음성 검색 개발과 같은 혁신에 기여했습니다. 그는 또한 온디바이스 처리 및 Google 어시스턴트 및 YouTube를 포함한 다양한 Google 제품에서 신경 모델 적용과 같은 개념을 발전시키는 데 중요한 역할을 수행하여 80개 이상의 언어를 지원하도록 확장했습니다. 이후 Google DeepMind에서는 멀티모달 인식 개발 및 Gemini 모델 제품군에 대한 기여를 포함한 대규모 언어 모델 발전에 참여했습니다. [1] [2]

2024년 5월, 샬크위크는 가정 및 전력망을 위한 임베디드 인텔리전스를 전문으로 하는 회사인 Sense에 인공지능 전략 고문으로 합류했습니다. 이 역할에서 그는 글로벌 에너지 전환을 지원하기 위해 AI 및 머신러닝을 활용하는 데 집중합니다. Sense에서의 그의 자문 업무는 데이터와 머신러닝을 사용하여 에너지 수요를 관리하고 효율성을 개선하며 그리드 안전을 강화하는 새로운 도구를 유틸리티 및 소비자에게 개발하는 것을 목표로 합니다. Sense는 머신러닝을 활용하여 소비자에게 가정 에너지 사용에 대한 실시간 통찰력을 제공하고 유틸리티에 고장 식별, 전력 흐름 추적 및 전력화 계획과 같은 작업을 위한 그리드 인텔리전스를 제공합니다. [1] [37] [38]

Meta Superintelligence Labs

2025년 6월, 마크 저커버그는 인공 초지능 개발에 집중하는 Meta Platforms 내의 새로운 조직인 Meta Superintelligence Labs(MSL)의 창설을 발표했습니다. 요한 샬크위크는 이 이니셔티브에 합류하는 주요 신규 팀원 중 한 명으로 지명되었습니다. MSL은 Llama 소프트웨어, 제품 및 기본 인공지능 연구 프로젝트를 포함하여 기초 모델에 대한 다양한 팀을 수용하기 위해 설립되었습니다. MSL의 구성과 샬크위크와 같은 최고의 AI 인재의 영입은 빠르게 진화하는 AI 환경에서 경쟁하기 위한 Meta의 노력의 일환입니다. [40] [41]

출판물

요한 샬크위크는 컴퓨터 과학 분야에서 음성 인식, 자연어 처리 및 머신러닝과 같은 분야에 중점을 둔 수많은 연구 논문을 공동 저술했습니다. 그의 출판물은 수십 년에 걸쳐 있으며 저명한 컨퍼런스 및 저널에 게재되었습니다.

주요 출판물은 다음을 포함합니다.

- 2020 – 현재

- Gemini 1.5: 수백만 개의 토큰 컨텍스트에서 멀티모달 이해 잠금 해제. CoRR abs/2403.05530 (2024) [3]

- 음성 인코더와 다운스트림 텍스트 모델 결합. CoRR abs/2407.17605 (2024) [4]

- SLM: 음성 및 텍스트 기초 모델 간의 얇은 간격 연결. ASRU 2023: 1-8 (2023) [5]

- Lego-Features: 스트리밍 및 심의 ASR을 위한 모듈식 인코더 기능 내보내기. ICASSP 2023: 1-5 (2023) [6]

- Google USM: 100개 이상의 언어를 넘어 자동 음성 인식 확장. CoRR abs/2303.01037 (2023) [7]

- AudioPaLM: 말하고 들을 수 있는 대규모 언어 모델. CoRR abs/2306.12925 (2023) [8]

- Gemini: 고성능 멀티모달 모델 제품군. CoRR abs/2312.11805 (2023) [9]

- 2010 – 2019

- 대규모 어휘 음성 인식을 위한 래티스 생성. ASRU 2017: 228-235 (2017) [10]

- 범용 음성 인터페이스를 지원하기 위한 Google의 음성 연구. New Era for Robust Speech Recognition, Exploiting Deep Learning 2017: 385-399 (2017) [11]

- 키보드 제스처 디코딩을 위한 장단기 메모리 신경망. ICASSP 2015: 2076-2080 (2015) [12]

- 순환 신경망을 사용한 음성 인식을 위한 음향 프레임 라벨링 학습. ICASSP 2015: 4280-4284 (2015) [13]

- 음성 쿼리 개선. INTERSPEECH 2012: 2462-2465 (2012) [14]

- 유한 상태 트랜스듀서의 효율적인 구성을 위한 필터 기반 알고리즘. Int. J. Found. Comput. Sci. 22(8): 1781-1795 (2011) [15]

- 개발을 위한 음성 검색. INTERSPEECH 2010: 282-285 (2010) [16]

- 모바일 음성 입력을 위한 주문형 언어 모델 보간. INTERSPEECH 2010: 1812-1815 (2010) [17]

- 음성 검색을 위한 쿼리 언어 모델링. SLT 2010: 127-132 (2010) [18]

- 가중 유한 상태 트랜스듀서의 효율적인 구성을 위한 필터. CIAA 2010: 28-38 (2010) [19]

- 2000 – 2009

- OpenFst. FSMNLP 2009: 47 (2009) [20]

- 모바일 미디어 검색. ICASSP 2009: 4897-4900 (2009) [21]

- GOOG-411에서 what-with-where에 대한 언어 모델링. INTERSPEECH 2009: 991-994 (2009) [22]

- 가중 유한 상태 트랜스듀서를 위한 일반화된 구성 알고리즘. INTERSPEECH 2009: 1203-1206 (2009) [23]

- 음향적으로 축소되지 않은 단어와 축소된 단어의 인식에서 의미론적 컨텍스트 효과. INTERSPEECH 2009: 1867-1870 (2009) [24]

- GOOG-411 배포: 데이터, 측정 및 테스트의 초기 교훈. ICASSP 2008: 5260-5263 (2008) [25]

- OpenFst: 일반적이고 효율적인 가중 유한 상태 트랜스듀서 라이브러리. CIAA 2007: 11-23 (2007) [26]

- 유한 상태 트랜스듀서를 사용한 동적 문법을 사용한 음성 인식. INTERSPEECH 2003: 1969-1972 (2003) [27]

- 1990 – 1999

- 범용 음성 도구: CSLU 툴킷. ICSLP 1998 (1998) [28]

- 미국 인구 조사를 위한 음성 대화 시스템 실험. Speech Commun. 23(3): 243-260 (1997) [29]

- CSLUsh: 확장 가능한 연구 환경. EUROSPEECH 1997: 689-692 (1997) [30]

- 낮은 저장 요구 사항으로 화자 검증. ICASSP 1996: 693-696 (1996) [31]

- 10,000개의 음성 대화 시스템 구축. ICSLP 1996: 709-712 (1996) [32]

- 음절과 유사한 단위를 사용한 음성 인식. ICSLP 1996: 1117-1120 (1996) [33]

- 전화 음성에서 사기꾼 감지. ICASSP (1) 1994: 169-172 (1994) [34]

- 미국 인구 조사를 위한 프로토타입 음성 응답 설문지. ICSLP 1994: 683-686 (1994) [35]

그의 연구에는 음성 및 언어 처리 애플리케이션에서 널리 사용되는 가중 유한 상태 트랜스듀서를 구성하고 조작하기 위한 툴킷인 OpenFst 라이브러리에 대한 기여가 포함됩니다. [26] [20]

잘못된 내용이 있나요?