0% read

Kimi (Language Model)

Kimi (Language Model)

Kimi는 베이징에 본사를 둔 스타트업 Moonshot AI에서 개발한 대규모 언어 모델(LLM) 시리즈입니다. 이 모델들은 큰 컨텍스트 창과, 후기 버전에서는 오픈 웨이트 아키텍처 및 에이전트 지능 기능으로 복잡하고 다단계 작업을 수행할 수 있는 것으로 유명합니다.

Kimi 챗봇 (2023)

오리지널 Kimi 챗봇은 2023년 10월 Moonshot AI에서 출시되었습니다. 출시 당시 가장 큰 특징은 단일 프롬프트에서 최대 20만 자의 중국어 문자를 처리할 수 있는 큰 컨텍스트 창이었습니다. 이 기능은 긴 문서와 복잡한 대화를 처리하는 데 중점을 두어 중국의 경쟁적인 AI 시장에서 강력한 경쟁자로 자리매김했습니다. 모델의 긴 컨텍스트 기능은 Moonshot AI 전략의 핵심 부분이었으며, 이는 2024년 초까지 회사의 가치를 25억 달러로 끌어올리는 데 기여했습니다. [6] [7]

Kimi K2 (2025)

개요

Kimi K2는 2025년 7월 11일 Moonshot AI에서 출시되었으며, 이 회사는 2023년 3월에 설립되었습니다. 에이전트 지능에 중점을 두고 설계된 오픈 웨이트 MoE(Mixture-of-Experts) 모델입니다. 이 릴리스는 AI 연구 커뮤니티에서 상당한 관심을 받았으며, 일부에서는 올해 초 DeepSeek의 모델 릴리스와 비교하기도 했습니다. [1] 이 모델은 코딩 및 추론 벤치마크에서 뛰어난 성능을 보이며, 비사고 평가에서 Anthropic의 Claude와 같은 서구 경쟁자를 포함한 많은 현대적인 오픈 소스 및 독점 모델과 일치하거나 능가합니다. [1] 머신 러닝 연구원 Nathan Lambert는 출시 후 "세계 최고의 새로운 오픈 모델"이라고 설명했습니다. [1]

Kimi K2의 등장은 미국-중국 AI 경쟁의 더 넓은 맥락에서 볼 수 있으며, Moonshot AI를 OpenAI 및 Anthropic과 같은 서구 AI 연구소에 대한 중요한 중국 경쟁자로 자리매김하고 있습니다. 이 스타트업은 중국 기술 대기업 Alibaba를 포함한 투자자들의 지원을 받는 것으로 알려졌습니다. [1]

Kimi K2의 핵심 설계 철학은 "에이전트 지능"이며, 이는 모델이 자율 에이전트 역할을 수행하는 능력을 우선시합니다. 프롬프트에 단순히 응답하는 대신, 사용자의 목표를 이해하고, 웹 브라우저, 코드 인터프리터 또는 API와 같은 적절한 도구를 선택하고, 목표를 달성하기 위해 일련의 작업을 실행하도록 설계되었습니다. 이 접근 방식은 단순한 채팅 기반 상호 작용에서 벗어나 보다 복잡한 문제 해결로 나아가기 위한 것입니다. [2]

Moonshot AI는 다양한 사용 사례에 맞게 모델을 두 가지 주요 변형으로 출시했습니다. Kimi-K2-Base는 사용자 정의 미세 조정을 위해 완전한 제어가 필요한 연구원 및 개발자를 위한 기본 모델입니다. Kimi-K2-Instruct는 범용 채팅 및 즉시 사용 가능한 에이전트 애플리케이션에 최적화된 사후 훈련 버전입니다. 모델 가중치와 관련 코드는 모두 수정된 MIT 라이선스에 따라 릴리스되어 개방형 연구 개발을 촉진합니다. [3]

기술

아키텍처

Kimi K2는 MoE(Mixture-of-Experts) 아키텍처를 기반으로 구축되어 총 매개변수의 수가 매우 많으면서도 각 추론에 대해 계산적으로 관리 가능한 활성화된 매개변수의 수를 유지할 수 있습니다. 이 설계는 효율성과 확장성을 향상시킵니다. 이 모델은 총 1조 개의 매개변수를 가지고 있으며, 토큰당 320억 개가 활성화됩니다. [4]

주요 아키텍처 사양은 다음과 같습니다.

- 총 매개변수: 1조 개

- 활성화된 매개변수: 320억 개

- 모델 레이어: 61개 (1개의 밀집 레이어 포함)

- 어텐션 헤드: 64개

- 총 전문가: 384명 (토큰당 8명 선택)

- 컨텍스트 길이: 128,000 토큰

- 어휘 크기: 160,000

- 활성화 함수: SwiGLU

- 어텐션 메커니즘: 다층 어텐션 (MLA)

이러한 사양은 프로젝트의 공식 기술 문서에 자세히 설명되어 있습니다. [3]

훈련 및 최적화

Kimi K2는 15조 5천억 개의 토큰 데이터 세트에서 사전 훈련되었습니다. 개발 중 중요한 기술 혁신은 MuonClip 옵티마이저의 생성입니다. 이 옵티마이저는 대규모 모델을 확장할 때 발생하는 일반적인 문제인 훈련 불안정성, 특히 "어텐션 로짓 폭발" 문제를 해결하기 위해 개발되었습니다. [2]

MuonClip 옵티마이저는 각 업데이트 후 쿼리(q) 및 키(k) 프로젝션의 가중치 행렬을 직접 재조정하는 "qk-clip"이라는 기술을 도입하여 Muon 옵티마이저를 기반으로 구축되었습니다. MuonClip은 소스에서 어텐션 로짓의 스케일을 제어하여 손실 스파이크를 효과적으로 방지하여 전체 15.5T 토큰 데이터 세트에서 안정적인 사전 훈련 프로세스를 가능하게 했습니다. [4]

에이전트 기능 개발

모델의 고급 에이전트 기능은 도구 사용 및 강화 학습에 중점을 둔 다단계 사후 훈련 프로세스를 통해 개발되었습니다.

대규모 에이전트 데이터 합성

모델에 도구를 효과적으로 사용하는 방법을 가르치기 위해 개발 팀은 대규모 데이터 합성 파이프라인을 만들었습니다. ACEBench 프레임워크에서 영감을 얻은 이 시스템은 수백 개의 도메인과 수천 개의 도구를 포함하는 복잡한 실제 시나리오를 시뮬레이션합니다. 이러한 시뮬레이션에서 AI 에이전트는 시뮬레이션된 환경 및 사용자 에이전트와 상호 작용하여 현실적인 다중 턴 도구 사용 데이터를 생성합니다. 그런 다음 LLM 기반 판정관은 미리 정의된 루브릭에 대해 이러한 상호 작용을 평가하여 고품질 예제를 필터링하고 훈련에 사용합니다. [2]

일반 강화 학습

Kimi K2의 훈련에는 검증 가능한 보상(예: 수학 문제 해결)과 검증 불가능한 보상(예: 양질의 보고서 작성)이 모두 있는 작업을 처리하도록 설계된 일반 강화 학습(RL) 시스템이 통합되어 있습니다. 검증 불가능한 작업의 경우 시스템은 모델이 자체 비평가 역할을 하는 자체 판정 메커니즘을 사용하여 확장 가능한 루브릭 기반 피드백을 제공합니다. 이 비평가는 검증 가능한 보상이 있는 작업에서 온-폴리시 롤아웃을 사용하여 지속적으로 개선되고 보정되어 평가 정확도가 높게 유지됩니다. 이 프로세스를 통해 모델은 더 광범위한 상호 작용에서 학습할 수 있으므로 인간이 주석을 단 데이터의 제한에서 벗어날 수 있습니다. [4]

성능 및 벤치마크

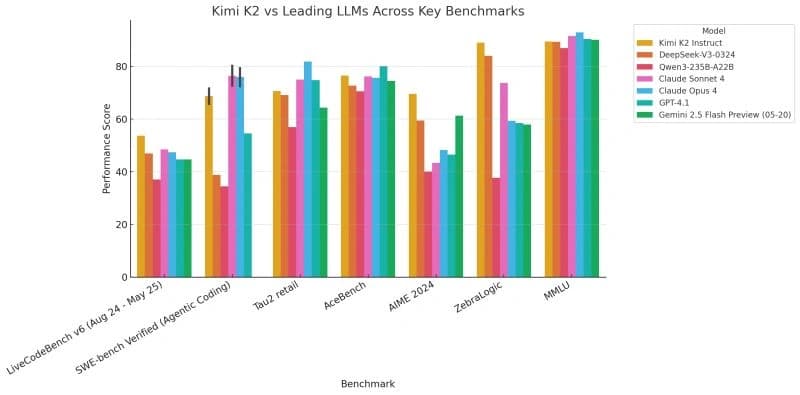

개발자와 독립적인 분석에 따르면 Kimi K2는 오픈 소스, 비사고 모델 중에서 최첨단 성능을 보여주며 서구 연구소의 주요 독점 모델과 매우 경쟁력이 있습니다. [1] [8] 이 모델은 특히 에이전트 작업, 코딩 및 수학에서 뛰어납니다.

에이전트 코딩 평가에서 Kimi K2는 SWE-bench Verified(단일 시도)에서 65.8%의 점수를 얻어 GPT-4.1(54.6%)을 능가하고 Claude 4 Opus(72.5%)와 비슷한 성능을 보였습니다. 또한 SWE-bench Multilingual에서 47.3%의 점수를 얻었습니다. 일반적인 도구 사용의 경우 AceBench(영어)에서 76.5%의 점수를 얻어 Claude 4 Opus(75.6%) 및 GPT-4.1(80.1%)과 경쟁력이 있었습니다. 이 모델은 코딩 벤치마크에서 강력한 성능을 보여 LiveCodeBench v6에서 53.7%의 Pass@1 비율을 달성했는데, 이는 Claude 4 Opus(47.4%)와 GPT-4.1(44.7%)보다 높습니다. OJBench에서 27.1%의 점수도 독점적인 상대방을 능가했습니다. 수학 및 STEM에서 Kimi K2는 AIME 2025 벤치마크에서 49.5%의 점수를 얻어 Claude 4 Opus(33.9%)와 GPT-4.1(37.0%)을 크게 능가했습니다. GPQA-Diamond 벤치마크에서 75.1%의 점수는 Claude 4 Opus(74.9%)와 비슷하고 GPT-4.1(66.3%)보다 앞섰습니다. 모델의 기술 보고서에 자세히 설명된 이러한 결과는 Kimi K2를 특히 소프트웨어 엔지니어링 및 자율 문제 해결과 관련된 작업에 매우 적합한 모델로 자리매김합니다. [2] [4]

사용 사례 및 애플리케이션

Kimi K2는 도구를 자율적으로 사용하여 복잡한 사용자 요청을 완료하도록 설계되었습니다. 사전 스크립트된 워크플로 없이도 높은 수준의 작업 설명을 해석하고, 필요한 단계를 결정하고, 코드 인터프리터 또는 웹 브라우저와 같은 통합 도구를 사용하여 실행할 수 있습니다.

Moonshot AI에서 시연한 눈에 띄는 예 중 하나는 급여 데이터 분석 작업입니다. 데이터 세트와 높은 수준의 프롬프트가 주어지면 Kimi K2는 IPython 도구를 사용하여 16단계 프로세스를 수행했습니다. 여기에는 데이터 로드 및 필터링, 원격 작업 비율 분류, 양방향 ANOVA 및 t-테스트와 같은 통계 분석 수행, 여러 시각화(예: 바이올린 플롯, 상자 그림, 막대 차트) 생성 및 결과 요약이 포함되었습니다. 최종 출력은 분석을 제시하는 완전한 대화형 HTML 웹 페이지와 개인화된 권장 사항을 위한 통합 시뮬레이터였습니다. [2]

다른 시연된 사용 사례는 다음과 같습니다.

- 웹 개발: 명령줄 도구 상호 작용을 통해 웹 기반 3D 버전의 Minecraft를 처음부터 작성합니다.

- 여행 계획: 검색, 캘린더, Gmail, 항공편 예약 및 레스토랑 예약 서비스를 통합하기 위해 17개의 원활한 도구 호출을 통해 자세한 여행 일정을 만듭니다.

- 연구 지원: 일련의 웹 검색, 페이지 탐색 및 코드 편집 작업을 통해 Stanford NLP Genealogy를 시각화하는 대화형 웹 사이트를 생성합니다.

이러한 예는 모델이 여러 도구를 오케스트레이션하여 복잡하고 다면적인 목표를 달성하는 능력을 강조합니다. [2]

가용성

Kimi K2는 여러 채널을 통해 액세스할 수 있습니다.

- 웹 및 모바일: Kimi K2 모델의 무료 버전은 공식 웹 사이트 및 모바일 애플리케이션의 Kimi 채팅 인터페이스를 통해 공개적으로 사용할 수 있습니다. [5]

- API 액세스: 개발자는 OpenAI 및 Anthropic 표준과 호환되는 API를 제공하는 Kimi 플랫폼을 통해 Kimi K2를 애플리케이션에 통합하여 쉽게 채택할 수 있습니다.

- 자체 호스팅:

Kimi-K2-Base및Kimi-K2-Instruct에 대한 오픈 웨이트 모델 체크포인트는 Hugging Face에서 사용할 수 있습니다. vLLM, SGLang, KTransformers 및 TensorRT-LLM과 같은 추론 엔진을 사용하여 온프레미스 또는 클라우드에 배포할 수 있습니다.

모델 및 해당 소스 코드는 수정된 MIT 라이선스에 따라 릴리스됩니다. [3]

제한 사항

개발자는 Kimi K2의 초기 릴리스에서 몇 가지 제한 사항을 확인했습니다. 이 모델은 어려운 추론 작업이나 모호하게 정의된 도구에 직면했을 때 과도한 수의 토큰을 생성할 수 있으며, 이로 인해 출력이 불완전해질 수 있습니다. 특정 시나리오에서는 도구 사용을 활성화하면 다른 작업의 성능이 저하될 수 있습니다. 또한 복잡한 소프트웨어 개발 프로젝트의 경우 모델은 간단한 원샷 프롬프트보다 에이전트 프레임워크 내에서 더 나은 성능을 보입니다. 비전 기능은 출시 당시 지원되지 않았지만 이러한 제한 사항을 해결하기 위해 향후 업데이트가 계획되어 있습니다. [2]

잘못된 내용이 있나요?

평균 평점

아직 평가가 없습니다

경험은 어땠나요?

빠른 평가를 해서 우리에게 알려주세요!

편집자

August 1, 2025. 15:10 UTC

편집 요약:

Updated wiki title to "Kimi (Language Model)"